第25届国际多媒体与博览大会Main Track录用CCIIP实验室2021级博士生彭道万同学(导师:魏巍)的论文“Overcoming Language Priors for Visual Question Answering Based on Knowledge Distillation”。第25届国际多媒体与博览大会(ICME2024)计划于2024年7月15日-7月19日在加拿大-尼亚加拉瀑布召开。ICME是IEEE旗下的多媒体计算旗舰会议,同时也是CCF推荐的多媒体计算领域B类国际学术会议。

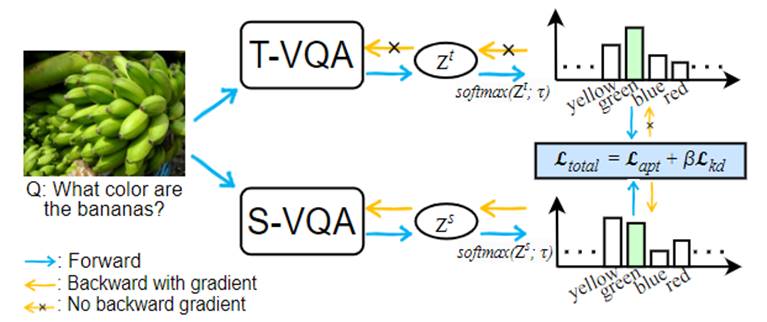

标题: Overcoming Language Priors for Visual Question Answering Based on Knowledge Distillation

作者: Daowan Peng, Wei Wei*.

内容简介:视觉问答(VQA)模型在学习推理过程中,容易依赖语言模态中存在的先验知识进行答案预测,因此容易导致模型仅依赖语言模态预测答案,而非对多模态信息的全面理解,从而降低视觉问答模型的泛化能力,其主要因为现有视觉问答模型通常依赖于频次高低来预测答案,即数据不平衡性导致模型带偏。因此,提出一种KDAR方法解决该问题,即首先将该问题建模为一个过拟合问题并利用知识蒸馏来解决视觉问答任务中的先验依赖性,其主要思想是利用良好训练的教师模型给定的弱标签(weakly label)对模型进行正则化规约,以惩罚模型对常见样本的拟合,为其提供类间相似语义监督信号,以模型缩小候选答案范围。同时,还设计了一种样本级的自适应加权学习策略,通过动态地调整单个样本重要性进一步减少模型的带偏问题。通过实验结果表明,所提方法在OOD和IID设置下均能提高模型的性能,尤其是在OOD基准上取得了目前最好性能,在精度上大幅超过已有最先进方法。

图1. KDAR方法示意图