第33届国际万维网会议全文录用CCIIP实验室2021级硕士生邹定同学(导师:魏巍)的论文“Knowledge Enhanced Multi-intent Transformer Network for Recommendation”论文。第33届国际万维网大会(WWW2024)计划于2024年5月13日-5月17日在新加坡召开。WWW(The Web Conference)是CCF推荐的A类国际学术会议,在信息检索/人工智能领域享有较高的学术声誉。这次会议的主赛道共收到破纪录的9862篇有效投稿,录用244篇,录用率约21.3%。

[论文题目]: Knowledge Enhanced Multi-intent Transformer Network for Recommendation

[作者]: Ding Zou, Wei Wei* (Corresponding Author), Feida Zhu, Chuanyu Xu, Tao Zhang and Chengfu Huo

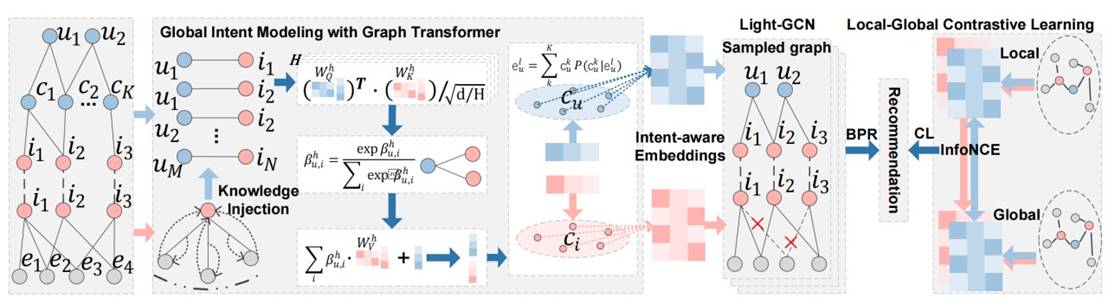

[论文概述]:有效利用知识图谱(Knowledge Graphs, KGs)丰富知识信息和可解释能力提升现有推荐系统能力一直是工业界关注和亟需解决的难题,但是传统方式的简单叠加KG信息往往在工业界推荐场景中带来明显的负优化问题,其主要存在如下两个问题:(1)用户多意图解缠:在基于知识图谱的推荐中涉及多种不同节点((包括用户、物品、关系、实体等),用户的意图分布在不同节点上的感兴趣程度不同,比如在电子商务中用户可能会表现出对特定样式、品牌或颜色的偏好;(2)知识噪声:其广泛存在于现有基于知识图谱推荐的方法中,在工业界场景中更为明显,现有工业界的数据规模种类繁多且数据庞大,简单引入知识图谱补充容易带来严重的知识噪声问题。因此,课题组和淘宝以及新加坡管理大学合作,提出一种Knowledge Enhanced Multi-intent Transformer Network for Recommendation (KGTN)模型,其主要包含两个模块::基于图Transformer的全局意图建模模块和意图下的知识对比去噪模块。其中,图Transformer的全局意图建模侧重于捕获可学习的用户意图,通过将来自用户-物品-关系-实体交互的全局信号与设计良好的图Transformer结合起来,同时学习意图感知的用户/物品表示;意图下的知识对比去噪致力于学习精确和鲁棒的用户/物品表示。它利用意图感知的用户/物品表征来采样相关知识,忽略意图无关的知识信息,因此提出了一种局部-全局对比机制来增强与噪声无关的表征学习。通过在三个公开基准数据集上实验表明,我们提出的模型优于目前的SOTA模型,并且在工业界阿里巴巴大型推荐平台的A/B Test测试中显著优于目前较已有最优模型,显示了所提模型在真实应用场景下的有效性。

KGTN算法框架图